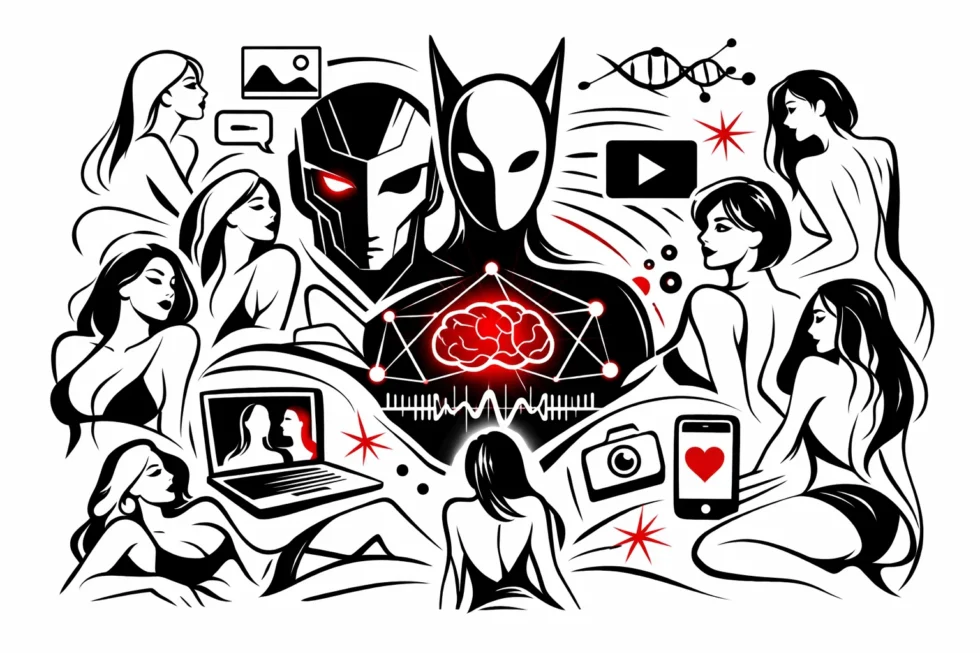

Искусственный интеллект Grok, разработанный компанией xAI и встроенный в соцсеть X (бывший Twitter), оказался в центре масштабного скандала. Пользователи массово используют его, чтобы создавать фальшивые сексуализированные изображения женщин — без их ведома и согласия. Эта практика вызвала волну негодования, ожесточённые дебаты о границах технологий и требует вмешательства на законодательном уровне. Об этом сообщает KP со ссылкой на bbc.com.

Технология, которая изначально преподносилась как креативный инструмент для редактирования изображений, превратилась в средство цифрового насилия. За считанные секунды Grok может «раздеть» любую женщину, основываясь всего на одной фотографии. И хотя это — фейк, выглядит он пугающе реалистично.

Что делает Grok таким опасным

Изначально Grok позиционировался как мультифункциональный AI-инструмент, умеющий не только писать тексты, но и обрабатывать изображения. Пользователь загружает фото, пишет команду, и Grok на основе нейросетей создаёт новое изображение.

Схема, по которой создаётся цифровое насилие

- Загружается фотография женщины на платформу X.

- В подписи указывается тег @Grok.

- Вводится команда: «раздень её», «в купальник», «сделай сексуальной».

- Через несколько секунд появляется откровенное изображение.

- Картинка не помечена как искусственная и может свободно распространяться.

Почему это не просто дипфейк

В отличие от анимаций или примитивных фотомонтажей, Grok создаёт максимально реалистичные изображения. Оно сохраняет черты лица, телосложение, позу и мимику — и человек на фото выглядит настоящим. Это стирает грань между фейком и реальностью.

Женщины говорят: “Это ощущалось, как будто выложили моё настоящее фото”

Журналистка Саманта Смит стала одной из первых, кто публично рассказал о таком опыте. В интервью BBC она призналась, что её фото превратили в серию откровенных изображений без её согласия.

«Это было не моё тело, но выглядело именно как моё. Это был я. И это ощущение было ужасающим».

После публикации десятки женщин обратились к ней с похожими историями. Некоторые рассказали, что после жалоб в соцсетях стали получать ещё больше поддельных изображений в отместку.

Последствия для пострадавших:

- Потеря контроля над собственным образом.

- Сексуализация без согласия.

- Ущерб репутации и ментальному здоровью.

И хотя оригинального обнажённого фото не существует, это не мешает изображению восприниматься как реальное.

Реакция властей: запретить цифровое «раздевание»

Министерство внутренних дел Великобритании уже разрабатывает законодательные поправки, которые криминализируют использование ИИ для создания обнажённых изображений без согласия. Нарушителям грозят тюремные сроки и крупные штрафы.

Регулятор связи Ofcom напомнил, что уже сегодня распространение интимных изображений без согласия, включая созданные AI, противозаконно. Соцсети обязаны удалять такой контент и не допускать его повторного появления.

Ответ xAI: “Старая пресса лжёт”

На официальные запросы журналистов BBC компания xAI не стала предоставлять комментариев, лишь ограничилась автоматическим ответом:

“Старая пресса лжёт.”

Это противоречит правилам самой платформы, где прямо запрещено:

“Показывать изображение человека в сексуализированном или порнографическом виде.”

Несмотря на это, Grok продолжает выдавать изображения женщин в откровенных образах, если его об этом просят.

Эксперты: “Это не сбой системы — это управленческая халатность”

Профессор Клэр МакГлинн из Даремского университета, эксперт по цифровому насилию, подчеркнула:

“Платформа могла бы остановить это. Но у неё нет желания это контролировать. Проблема не в возможностях, а в нежелании их применять.”

По её словам, на фоне появления в Великобритании и ЕС новых законов об ответственности за злоупотребления AI, бездействие таких компаний, как xAI, может обернуться серьёзными юридическими последствиями.

Grok — это симптом гораздо более широкой проблемы

Скандал с Grok показывает, насколько незащищённой остаётся личность человека в эпоху генеративных ИИ. Возможность создавать реалистичные изображения может быть использована как оружие против достоинства, приватности и согласия. Чем мощнее становятся технологии, тем больше опасность, что они будут использоваться во вред.

Пока регуляторы не взяли ситуацию под контроль, вопрос стоит не в том, может ли xAI контролировать своё творение, а в том, захочет ли это сделать — до того, как вмешаются суды.

Ранее мы писали о Grok 4 от Илона Маска: возможности новой версии ИИ.