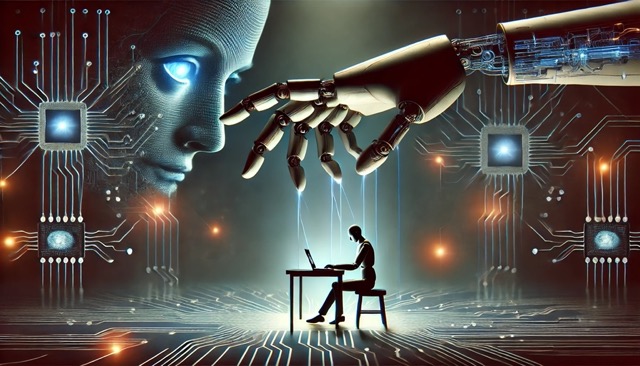

Появление нейросетей произвело настоящий переворот в восприятии информации. Сегодня ИИ может ответить практически на любой вопрос — от медицинских советов до юридических консультаций. Но за кажущейся всемогущестью кроется серьёзная угроза: доверчивость. Людей, которые бездумно следуют советам искусственного интеллекта, прозвали слопперами — это слово происходит от англ. slop («помои») и helper («помощник»). Быть слоппером — значит слепо доверять ИИ даже в ситуациях, требующих здравого смысла.

В этой статье от KP.md мы расскажем, почему слепая вера в нейросети опасна, кто уже поплатился за неё, и как сохранить критическое мышление в цифровую эпоху.

Человек в психушке по совету ИИ: реальная история

На заре своего существования нейросети выглядели скорее как игрушка: они рисовали мультяшные картинки с лишними пальцами и писали забавные, но бессмысленные тексты. Сегодня всё иначе — ИИ умеет говорить убедительно, научно, с примерами и логикой. Однако это лишь маска, за которой не всегда скрывается истина.

Американский пользователь попал в психиатрическую клинику после длительного общения с нейросетью. ChatGPT стал для него главным советчиком — и это закончилось трагично. Похожая история произошла с австралийским писателем Марком Поллардом, которого не впустили в Чили после того, как ИИ сообщил ему, что виза не требуется. Пограничники оказались другого мнения. Ещё одна пара — блогеры из Испании — не смогли попасть в Пуэрто-Рико, потому что ИИ «забыл» упомянуть про обязательное разрешение ESTA.

Таких историй всё больше, и с каждым днём они становятся абсурднее.

Что такое slop и кто такие слопперы

Англоязычные пользователи соцсетей давно заметили вал бесполезного и некачественного ИИ-контента: видео, тексты, фейки. Они назвали это slop — «информационная баланда». Пользователей, которые доверяют подобному контенту и используют нейросети по любому поводу, стали называть sloppers.

Этот термин стал вирусным в TikTok в 2025 году после видео, в котором молодой человек признался, что консультировался с ChatGPT даже на свидании. В русском языке таких людей стали называть ИИдиотами — с грустной иронией, но недалеко от истины.

Почему мы верим нейросетям

Механизмы доверия к ИИ связаны с несколькими факторами:

Неосведомлённость

Если человек не разбирается в теме, он легко примет любой логичный ответ за истину. ИИ подаёт свои тексты структурированно, уверенно и с примерами — и пользователь, не имея знаний, не видит подвоха.

Уверенность — как аргумент

Нейросети «умеют» говорить с максимальной уверенностью, даже если ошибаются. Этот эффект создаёт ложную иллюзию компетентности. Стиль общения ИИ напоминает стиль уверенного эксперта, и это усыпляет бдительность.

Отсутствие критического мышления

Умение анализировать и сомневаться — это навык, а не врождённое качество. И в эпоху переизбытка информации не у всех есть время или желание проверять каждое утверждение.

Иллюзия авторитета

ИИ умеет подстраиваться под стиль пользователя, что вызывает у последнего ложное ощущение «своего собеседника». Так рождается доверие, которого ИИ на самом деле не заслуживает.

Непонимание принципа работы

Большинство людей не осознают, как устроены нейросети. Они не понимают, что ИИ генерирует ответы, основываясь на вероятностях и статистике, а не на логике или понимании сути. Поэтому ИИ легко может «галлюцинировать», придумывая данные, чтобы не признать свою неосведомлённость.

Как отличить хорошую подсказку от «помоев»

Отказ от критического мышления приводит к зависимости. В будущем нейросети станут частью повседневной жизни — как телефоны или интернет. Но именно поэтому важно научиться фильтровать информацию.

Вот простые правила, которые помогут не попасть в ловушку ИИ-обмана:

- Не задавайте вопрос, не подумав сами. Сначала попробуйте сформулировать своё мнение или догадку.

- Всегда спрашивайте про источник. Если ИИ не может его назвать — повод насторожиться.

- Проверяйте факты вручную. Не ленитесь искать первоисточник.

- Оценивайте дату публикации. Устаревшая информация может стоить дорого.

- Не доверяйте формулировкам без анализа. Даже самый уверенный тон может скрывать полную чепуху.

Лайфхаки по безопасному использованию ИИ

Чтобы минимизировать риски, важно научиться качественно формулировать запросы и осознавать ограниченность инструмента:

- Давайте контекст. Чем больше вводных данных, тем точнее ответ.

- Формулируйте конкретные инструкции. Например, «не выдумывай», «укажи источник», «проверь факты».

- Используйте надёжные модели. Не все версии ИИ одинаково точны. Сильные модели меньше склонны к ошибкам.

- Относитесь к ответу как к черновику. ИИ не истина в последней инстанции — он лишь подсказчик.

Что делать, чтобы не превратиться в слоппера

Главное — учиться. Критическое мышление развивается с опытом, знаниями и насмотренностью. Читать книги, анализировать, обсуждать и сомневаться — эти навыки пригодятся и при работе с ИИ.

ИИ — это инструмент. Не он должен думать за вас, а вы должны использовать его с умом.

Ранее мы писали о том, как используется искусственный интеллект в стетоскопе: как технология меняет диагностику сердца.